메타(Meta)의 최신 인공지능 모델 시리즈인 Llama 4가 공개되면서, AI 산업이 또 한 번 큰 변화의 흐름을 맞이하고 있습니다. 특히 Llama 4는 ‘멀티모달 기능’, ‘초장문 처리 능력’, 그리고 ‘오픈소스 공개 범위’ 측면에서 경쟁사인 OpenAI, DeepSeek, Google 등의 최신 모델들과 견주어도 손색이 없는 강점을 보이고 있습니다.

이번 글에서는 Llama 4의 핵심 기능과 기술적 진보는 물론, 각 모델의 성능 비교와 실제 활용 사례를 통해 Llama 4가 앞으로 AI 생태계에 어떤 영향을 줄 수 있을지를 조망해보도록 하겠습니다.

목차

Llama 4: 전 라인업 총출동

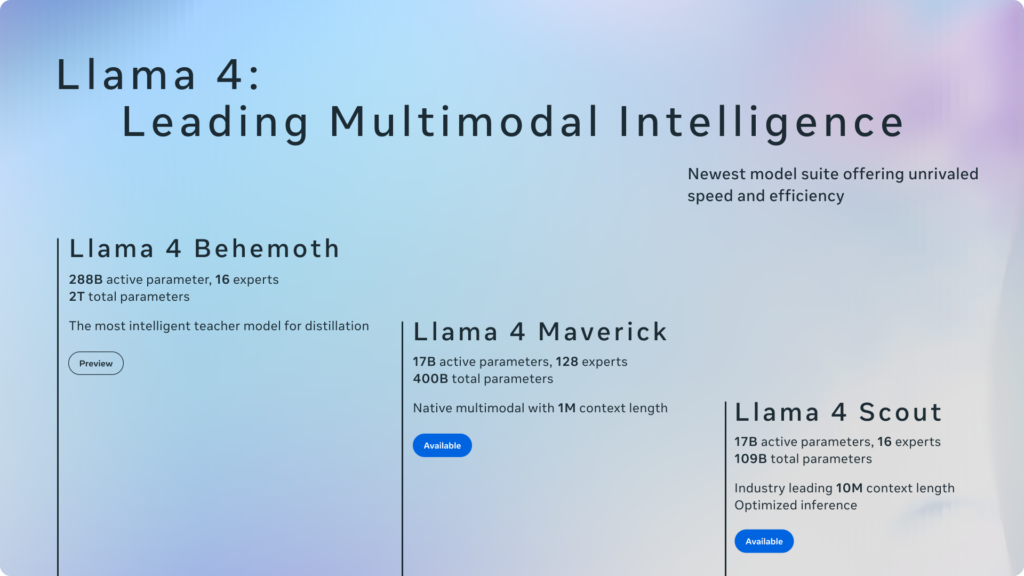

Llama 4 시리즈는 세 가지 주요 모델로 이루어져 있습니다. 가장 작고 빠른 모델은 Llama 4 Scout(109B 파라미터), 중간급 모델은 Llama 4 Maverick(400B 파라미터), 그리고 아직 프리뷰 단계이지만 가장 강력한 성능을 자랑하는 Llama 4 Behemoth(2T 파라미터)입니다. 세 모델 모두 메타가 새롭게 적용한 Mixture-of-Experts(MoE) 아키텍처를 기반으로 하며, 텍스트뿐 아니라 이미지와 영상을 동시에 이해할 수 있는 멀티모달 처리를 지원합니다. 단순한 LLM(Large Language Model)에서 더 나아가, 인간의 다양한 의사소통 형태를 폭넓게 다룰 수 있는 범용 AI로의 진화를 시사하고 있습니다.

Mixture-of-Experts 구조, 고성능과 효율을 동시에

Llama 4의 핵심 기술인 MoE 아키텍처는 기존 모델과는 연산 구조부터 다릅니다. 일반적인 LLM은 입력될 때마다 전체 파라미터를 일괄적으로 사용하지만, MoE 구조에서는 입력에 최적화된 일부 ‘전문가 모델’만 선택적으로 활성화됩니다. 예를 들어, Llama 4는 128개의 전문가 집합을 보유하고 있으며, 연산 시 이 중 두 개만을 선택해 사용하는 방식입니다. 덕분에 성능은 유지하면서도 GPU 자원 소비와 추론 비용이 대폭 절감됩니다.

특히 Llama 4 Scout은 고사양의 단일 GPU 서버(H100)에서도 원활하게 작동하고, 다수의 서버에 걸친 분산 추론도 가능합니다. 이는 비용 부담을 줄이면서도 확장 가능한 AI 솔루션 도입을 가능케 하는 중요한 요소입니다.

Scout 모델, 초장문 컨텍스트 시대 개막

Llama 4 Scout는 긴 문서 처리에 있어서 새로운 기준을 제시했습니다. 최대 1천만 토큰, 즉 약 15,000페이지에 해당하는 텍스트를 단일 입력으로 분석할 수 있는 역량을 갖췄습니다.

예를 들어, 글로벌 제약사는 수천 건의 논문을 한 번에 분석해 새로운 신약 후보를 뽑아냈고, 법무법인에서는 수백 페이지의 계약서를 단 한번의 호출로 요약해 냈습니다. 공공기관의 수년치 회의록도 하나의 AI 질의로 요약하는 데 성공했습니다. 이처럼 Scout는 단순한 문장 이해 수준을 넘어, 정보의 홍수 속에서 핵심을 추출하고 정리해 주는 ‘지식 집약형 비서’ 역할을 무리 없이 수행해 줍니다.

Maverick, 실전 업무에 최적화된 멀티모달 AI

Llama 4 Maverick은 말 그대로 멀티모달 시대를 위한 실전형 모델입니다. 문서, 이미지, 수식 등이 혼합된 복합 콘텐츠를 동시에 분석할 수 있어, 기업에서의 업무 활용 가능성이 매우 높습니다. 성능도 뛰어납니다.

예를 들어, 차트 해석 능력을 평가하는 ChartQA 벤치마크에서는 90점을 획득해 GPT-4o(85.7점)보다 앞섰고, 문서 기반 질의응답을 다루는 DocVQA에서도 94.4점으로 경쟁 모델을 압도했습니다. 이는 매뉴얼 해석, 기술자료 분석 등의 환경에서 업무 자동화를 가능하게 해주며, 실제로 기업 고객 응대, 계약서 분석, 교육 자료 요약 등에서 뛰어난 효율을 보여주고 있습니다.

Behemoth, AI ‘거물’의 탄생을 예고하다

2조 파라미터라는 방대한 모델 크기를 자랑하는 Llama 4 Behemoth는 아직 프리뷰 단계지만, 상위 벤치마크에서는 이미 충분한 실력을 입증했습니다. MATH-500처럼 수학적 추론을 요구하는 과제에서는 95점을 기록하며 GPT-4.5에 필적하는 성과를 올렸고, GPQA, MMLU Pro 등 고난도 질의응답 테스트에서도 상위권에 위치했습니다.

절대적인 파라미터 수 외에도, Behemoth는 논리적 사고와 수식 계산과 같은 고수준 AI 작업에서 강점을 보이고 있어, 신약 개발, 금융 모델링, 고급 통계 분석 등에서 활용될 가능성이 큽니다.

GPT보다 90% 저렴한 Llama, AI의 대중화를 이끈다

현재 Llama 4의 Maverick 모델은 100만 토큰 기준으로 약 0.19~0.49달러의 추론 비용이 듭니다. 이는 OpenAI의 GPT-4o(4.38달러)와 비교할 때 최대 90% 저렴한 수준으로, 중소기업과 스타트업도 자체 AI 도구를 구축하는 데 큰 부담이 없습니다. 이제 AI는 더 이상 일부 대기업의 전유물이 아닙니다. 보다 저렴한 가격에 실무형 AI를 도입할 수 있는 시대가 도래하고 있는 셈입니다.

MetaP: 대형 모델 튜닝을 자동화하다

Llama 4 개발 과정에서 또 하나 주목받은 기술은 MetaP입니다. 이는 하이퍼파라미터 튜닝—즉, 모델 성능을 높이기 위한 설정값 조정을 소형 모델에서 미리 실험해 보고, 그 결과를 다양한 규모의 모델에 그대로 적용할 수 있게 만드는 기술입니다.

초대형 모델인 Behemoth처럼 30조 토큰을 학습해야 하고, 3만 개 이상의 GPU를 동원하는 경우에는 이런 자동화 기술이 없으면 시간과 자원이 무한히 소비될 수 있습니다. MetaP는 그 비용과 시간을 획기적으로 줄이는 데 성공하였습니다.

열린 생태계 지향, Llama의 철학

메타는 Llama 모델들을 오픈소스 형태로 공개하는데 앞장서왔고, 이번 Llama 4 역시 Scout와 Maverick 모델을 Hugging Face 및 llama.com을 통해 직접 다운로드할 수 있게 했습니다. 누구나 접근하고 실험해볼 수 있는 구조로 열려 있는 것입니다.

다만 월간 사용자 수가 7억 명을 넘는 초대형 기업은 별도 라이선스 계약이 필요하지만, 전체적인 방향성은 OpenAI나 Anthropic처럼 API 중심의 폐쇄형 구조와는 단연 구분됩니다. 이는 AI 커뮤니티 전체에 활력을 불어넣는 긍정적인 전략으로 평가되고 있습니다.

안전성과 윤리성도 함께 설계되다

AI의 신뢰성과 윤리는 최근 업계의 핵심 화두인데, 메타 또한 이에 대응하는 기술을 동시에 선보이고 있습니다. 위험하거나 공격적인 텍스트를 감지하는 Llama Guard와 Prompt Guard, 그리고 모델 자체를 테스트하는 자동화 레드팀인 GOAT를 통해, 오남용 가능성을 최소화하려는 노력이 돋보입니다.

한편 정치적 균형성 확보에도 신경을 썼습니다. 훈련 과정에서 특정 진영의 편향을 줄이고, 중립적인 정보 전달에 집중하도록 설계되었다고 메타 측은 설명하고 있습니다. 보다 실용적이고 신뢰할 수 있는 AI 개발을 위한 의도가 엿보이는 대목입니다.

결론: AI 생태계를 다시 여는 메타의 변곡점

Llama 4는 단순히 새로운 AI 모델이 아니라, ‘무겁고 비싼 AI’에서 ‘가볍고 유연한 AI’로 패러다임을 전환시키려는 메타의 전략적 의도가 반영된 제품군입니다. OpenAI API의 높은 사용료가 부담되는 조직이라면 Llama 4는 분명한 대안이 될 수 있습니다. 멀티모달 AI 도입이나 초장문 분석이 필요한 엔터프라이즈 조직에게는 Maverick과 Scout 모델이 실용적입니다. 또 미래형 고성능 AI 인프라를 고려하는 대기업 및 연구소에겐 Behemoth 모델이 새로운 기회가 되어줄 것입니다.

이제 메타는 단순한 SNS 플랫폼이 아니라, AI 인프라 공급자로 진화하고 있습니다. DeepSeek의 혜성같은 등장으로 살짝 소외되었던 Llama가 다시 한번 많은 관심을 끌 것으로 보이네요. AI를 활용하는 입장에서 이러한 경쟁은 반가운 일이니 자신의 상황에 맞는 AI 모델을 선정하고, 이를 실전에 활용할 수 있도록 계속 이런 변화를 쫓아가면 좋겠습니다.

| AX 100배의 법칙 – 나와 조직의 능력을 100배 높이는 AI 경영의 실제 도서 구매 |

함께 읽으면 좋은 글:

디지털 트랜스포메이션: 조직의 습관을 바꾸는 일, 도서 구매