AI 코딩이 드러낸 진짜 병목: 기업 도입 3단계 플레이북

"코드는 그 어느 때보다 빨리 나오는데, 제품은 왜 그대로일까?" 많은 경영진이 던지는 이 질문의 답은 의외로 단순합니다. 코딩은 한 번도 진짜 병목이었던 적이 없으니까요. 에이전트 AI 코딩이 쏟아내는 코드 속에서 거버넌스·비용·인재 세 가지가 어떻게 새로운 병목이 되는지, 인원 감축이라는 성급한 결론을 내리기 전에 무엇을 점검해야 하는지 3단계 플레이북으로 정리했습니다. AI 코딩 도입을 앞두고 있다면 5분만…

AI 자동화 해고 시대: 클릭업 22% 감원이 보여주는 일의 미래

직원 22%를 자르면서 남은 직원에게는 '밀리언 달러 연봉'을 약속한 CEO가 있습니다. 클릭업(ClickUp)은 3,000개 AI 에이전트를 배치하고 '100x 조직'을 선언했지만, 가트너 데이터는 AI 자동화 해고가 기대만큼의 수익을 가져오지 못한다고 말합니다. 비용 절감과 AI 전환의 경계, 그리고 한국 직장인이 지금 당장 준비해야 할 3가지를…

구글 IO 2026 키노트 핵심 정리: Gemini 3.5·Omni와 AI 에이전트 시대

구글 IO 2026이 막을 내리며 'AI 에이전트의 해'를 공식 선언했습니다. Gemini 3.5 Flash는 동급 프론티어 모델 대비 4배 빠르고 가격은 절반 수준, Gemini Spark는 사용자가 잠든 사이에도 메일·일정·쇼핑·계획까지 처리합니다. 12시간 만에 운영체제 한 벌을 만든 Antigravity 2.0 시연부터 삼성·젠틀몬스터·와비파커가 함께 만든 AI 안경 첫 공개까지, 구글 IO 2026 키노트 핵심 발표를 5분 안에 따라잡고…

NordVPN vs ExpressVPN vs Surfshark: 3사 속도·가성비 완전 비교 (2026)

2026년 NordVPN vs ExpressVPN vs Surfshark를 한국 회선 기준으로 직접 비교했습니다. 속도·가격·스트리밍 우회·보안 기능·동시 접속 디바이스 수까지 한 표로 정리하고, 사용 패턴별 추천 VPN을…

2026년 VPN 추천 BEST 8: 속도·보안·스트리밍·가격 비교 (2026.01)

2026년 VPN 추천 BEST 8을 속도·보안·스트리밍·가격 4가지 기준으로 비교했습니다. NordVPN, ExpressVPN, Surfshark, ProtonVPN, Mullvad, IVPN, CyberGhost, AtlasVPN 장단점과 장기 플랜 가격, 환불 정책, 용도별 추천을 한 번에…

무제한 호스팅 CPU IO 제한: 약관 속 함정 읽는 법 (2026)

"트래픽 무제한"이라더니 왜 갑자기 503/508 오류가 날까요? 정답은 약관에 있습니다. 무제한 호스팅 CPU IO 제한은 CPU·RAM·I/O·Inode·Entry Process 5개 항목에 숨어 있어요. DreamHost·SiteGround·Hostinger 실제 정책과 결제 전 5가지 질문 템플릿까지, 5분만 투자해 잘못된 호스팅 1년 계약을…

가성비 호스팅 추천 2026: 포트폴리오·블로그용 7곳 비교 (정적·워드프레스)

“월 PV 1만도 안 되는데 호스팅비로 1년에 12만 원 쓰고 있지 않으세요?” 첫 결제 1~3달러가 갱신가에서 5~10배로 뛰는 함정, 정적 사이트면 Cloudflare Pages·GitHub Pages로 사실상 무료에 더 빠른데 놓치기 쉽습니다. 가성비 호스팅 추천 7곳을 TTFB·갱신요금·일일 트래픽·24/7 기준으로 비교하고 포트폴리오·정적·WP 용도별 정답까지 골라뒀습니다. 결제 전 5분만…

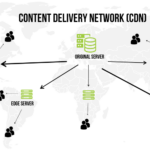

멀티사이트 운영 최적화 가이드 2026: 5~10개·100개+ 도메인 한 계정 전략

"도메인 5개 넘어가니까 어느 사이트가 다운됐는지도 못 따라가요." 멀티사이트 운영 최적화의 정답은 도메인 수에 있지 않고 5레이어(접근·엣지·오리진·데이터·수익화) 표준화에 있습니다. 5~10개 시나리오부터 100개 이상 미디어 그룹까지, WordPress 멀티사이트·cPanel addon·Cloudflare·AdSense·UptimeRobot을 한 계정으로 묶는 구체 구성표를 정리했습니다. 운영 사고로 시간 빼앗기기 전에 5분만…

백업은 옵션이 아니다: 자동 백업 복구 테스트와 비용 비교 (2026)

“백업은 켜져 있는데 복구가 안 된다.” 운영 현장에서 가장 위험한 순간입니다. 랜섬웨어·실수 삭제·하드웨어 고장은 예고 없이 옵니다. 자동 백업 복구 테스트는 옵션이 아니라 표준입니다. 3-2-1 규칙, UpdraftPlus·Cloudways·VaultPress 비교, 분기 1회 복구 드릴, $5 자동 솔루션과 $50 매니지드, 자체 S3+cron까지 사이트 규모별 추천 조합을 정리했습니다. 사고 전에 5분만…

호스팅 보안 설정 8가지: 2FA·WAF·권한 2026 실전 체크리스트

"보안 솔루션을 다 깔았는데 또 뚫렸다" — 호스팅 사고의 절반은 솔루션이 아니라 호스팅 보안 설정 8가지가 빠져 있어서입니다. 2FA·SSL Full(Strict)·WAF 레이트리밋·방화벽·SSH 키·파일 권한 644/755·자동 패치·백업 암호화까지, 30분이면 잠그는 2026 실전 체크리스트로 오늘…