가성비 호스팅 추천 2026: 포트폴리오·블로그용 7곳 비교 (정적·워드프레스)

“월 PV 1만도 안 되는데 호스팅비로 1년에 12만 원 쓰고 있지 않으세요?” 첫 결제 1~3달러가 갱신가에서 5~10배로 뛰는 함정, 정적 사이트면 Cloudflare Pages·GitHub Pages로 사실상 무료에 더 빠른데 놓치기 쉽습니다. 가성비 호스팅 추천 7곳을 TTFB·갱신요금·일일 트래픽·24/7 기준으로 비교하고 포트폴리오·정적·WP 용도별 정답까지 골라뒀습니다. 결제 전 5분만…

멀티사이트 운영 최적화 가이드 2026: 5~10개·100개+ 도메인 한 계정 전략

"도메인 5개 넘어가니까 어느 사이트가 다운됐는지도 못 따라가요." 멀티사이트 운영 최적화의 정답은 도메인 수에 있지 않고 5레이어(접근·엣지·오리진·데이터·수익화) 표준화에 있습니다. 5~10개 시나리오부터 100개 이상 미디어 그룹까지, WordPress 멀티사이트·cPanel addon·Cloudflare·AdSense·UptimeRobot을 한 계정으로 묶는 구체 구성표를 정리했습니다. 운영 사고로 시간 빼앗기기 전에 5분만…

공유 호스팅 vs VPS vs 클라우드 호스팅 비용·성능·확장성 한눈 비교(2026 가이드)

"공유 호스팅 vs VPS vs 클라우드 호스팅, 결국 뭐가 제일 이득이에요?" — 월 $1.99 프로모션과 월 $40 클라우드 구성, 그 사이 어디가 정답인지 헷갈린다면 2026년 공식 가격표(AWS Lightsail·DigitalOcean·cPanel·Hostinger)를 기준으로 비용·성능·확장성과 갱신가·트래픽 초과·제어판 라이선스 같은 숨은 비용까지 한 표에 정리했습니다. 공유 호스팅 vs VPS vs 클라우드 호스팅 결정을 5분 안에 끝내고…

관리형 DB 추천: RDS vs Cloud SQL vs Cosmos DB, 목적별 선택 가이드(2026)

"RDS와 Cloud SQL 중 뭐가 더 좋아요?" — 클라우드 인프라 미팅에서 가장 자주 나오는 질문이지만 정답은 늘 "목적에 따라 다릅니다." 그렇다면 우리 팀에는 무엇이 맞을까요? AWS RDS·Google Cloud SQL·Azure Cosmos DB를 SQL 조인부터 글로벌 분산, HA, 비용 폭탄 포인트까지 7가지 실무 시나리오로 비교해 후회 없는 관리형 DB 추천 기준을 정리했습니다. 도입을 앞두고 있다면 지금 5분만…

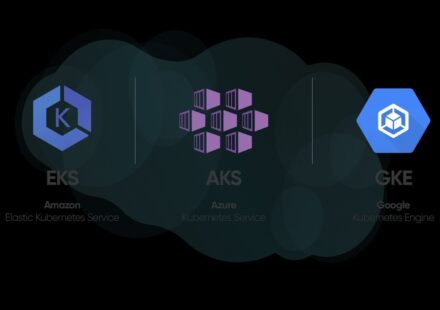

EKS vs AKS vs GKE 비용 비교 2026: 운영 난이도와 숨은 비용까지 정리

EKS, AKS, GKE 비용 비교를 2026년 기준으로 정리했습니다. 관리비, 운영 난이도, 업그레이드 책임, 숨은 비용까지 실무 관점에서 비교합니다.

서버리스 비용 절감 가이드: Functions와 DB 설계를 함께 봐야 하는 이유

서버리스 비용 절감을 위해 Functions와 DB를 어떻게 함께 설계해야 하는지 정리했습니다. 고정비를 줄이는 구조와 클라우드별 선택지를 실무 중심으로 설명합니다.

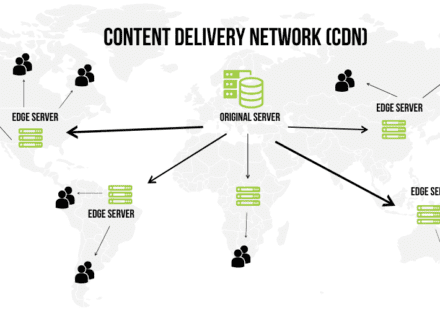

Cloudflare vs Fastly vs Akamai 비용 비교 2026: 어떤 CDN이 유리한가

Cloudflare, Fastly, Akamai의 CDN 비용 구조를 2026년 기준으로 비교합니다. 트래픽, 캐시, 전송비, 운영 관점에서 어떤 선택이 유리한지 정리했습니다.

GCP 데이터·AI 워크로드 강점 분석: 구글 클라우드가 특히 강한 영역은 무엇인가

왜 GCP가 데이터와 AI 워크로드에 강한지 실무 관점에서 분석했습니다. 분석, ML, 데이터 플랫폼, 운영 효율 측면의 차별점을 정리합니다.

Azure를 선택하는 이유: Microsoft 생태계 연동이 강한 조직에 왜 유리한가

Azure와 마이크로소프트 생태계 연동이 실제 비즈니스에 주는 강점과 한계를 분석했습니다. M365, Entra, 보안, 운영 관점에서 핵심만 정리합니다.

AWS 비용 폭탄 방지 체크리스트: 예산 알림·태그·권한·한도 설정 가이드

AWS 비용 폭탄을 막기 위한 실무 체크리스트를 정리했습니다. 예산 알림, 태그, 권한, 서비스 쿼터, 운영 통제 포인트를 한 번에 점검할 수 있습니다.