클라우드 모니터링 툴 비교 2026: Datadog vs New Relic vs Grafana Cloud 가이드

“Datadog이 비싸요? 그럼 New Relic이나 Grafana Cloud가 답일까요?” — 운영팀이 가장 자주 받는 질문이지만 정답은 “비용 폭탄이 어디서 터지느냐”에 따라 다릅니다. 이번 클라우드 모니터링 툴 비교에서는 Datadog·New Relic·Grafana Cloud 세 옵저버빌리티 도구를 가격 모델, OpenTelemetry 지원, APM 비교, 로그 비용, 리전 정책까지 8가지 실무 축으로 정리했습니다. 우리 팀에 맞는 SRE…

Claude Design 완벽 분석: AI로 Figma에 도전하는 프로토타입 툴

"Figma 없이 UI 프로토타입을 만들 수 있을까?" Anthropic이 2026년 4월 공개한 Claude Design은 텍스트 프롬프트만으로 앱 화면, 슬라이드, 마케팅 자료를 즉시 생성합니다. Figma 주가를 7.5% 끌어내린 이 툴의 실제 기능과 국내 팀 도입 전 확인할 4가지 체크리스트를…

WAF DDoS 방어 서비스 비교 2026: Cloudflare·AWS·Azure·GCP 실무 가이드

"WAF 붙였는데 DDoS는 왜 여전히 뚫릴까?" Cloudflare·AWS·Azure·GCP의 WAF DDoS 방어 서비스 비교를 공식 문서 수치로 한 장에 정리. 월 5천만 요청 기준 AWS WAF 약 $45, Cloud Armor $52.5, Cloudflare Pro $25, Azure Front Door $35부터 계산식과 7가지 기능 체크까지 포함했습니다. 5분만…

제로트러스트 구현 가이드: 클라우드 환경 단계별 설계 (2026)

제로트러스트 구현, 어디서부터 시작해야 할까요? VPN을 없애는 것이 아니라 매 요청마다 검증하는 운영 체계를 만드는 것이 핵심입니다. NIST PDP/PEP 구조부터 5대 Pillar(Identity/Device/Network/App/Data), 클라우드 서비스 매핑, 90일 실행 로드맵까지 실무 관점에서 정리했습니다. AWS Verified Access, Google IAP, Microsoft Entra 등 주요 서비스별 대응표와 실패 패턴…

IAM 권한 설계 실수 TOP 10과 예방책 (AWS/Azure/GCP 공통)

"RDS Admin 줬더니 전체 DB가 날아갔습니다" — 클라우드 보안 사고의 80%는 IAM 권한 설계 실수에서 시작됩니다. Root/Owner 계정 남용, 와일드카드(*) 정책 남발, 장기 자격증명 방치, 스코프 과다 부여까지. AWS·Azure·GCP 공통으로 적용 가능한 IAM 권한 설계 실수 TOP 10과 예방책, 그리고 15분이면 끝나는 실무 점검 체크리스트를 한 글에 정리했습니다. 지금 바로 우리 조직의 IAM 상태를 점검해…

멀티클라우드 vs 하이브리드: 유행이 아니라 요건으로 판단하기 (2026 실무 가이드)

멀티클라우드 해야 할까, 하이브리드가 답일까? 트렌드에 휩쓸리지 말고 '요건'으로 판단하세요. 온프렘이 필요한지, CSP를 2개 이상 써야 하는지 — 이 두 질문만으로 단일 클라우드, 멀티클라우드, 하이브리드, 하이브리드 멀티클라우드 중 최적 선택지가 정해집니다. NIST, CIO Council, NSA, AWS, Azure, Google 공식 문서 기반으로 요건 8가지 판단 기준과 실패를 막는 레드 플래그 7가지까지 한 번에…

재해복구 DR 전략: RTO/RPO 기준으로 설계하는 2026 실무 가이드

RTO를 초과하면 비즈니스가 멈춥니다. 그런데 대부분의 팀은 재해복구 DR 전략을 기술부터 고릅니다 — 순서가 반대입니다. RTO/RPO로 역산해 설계하는 법, Backup부터 Active/Active까지 4단계 비용·복잡도 비교, AWS·Azure·GCP 구현 포인트를 실무 체크리스트로 정리했습니다. 지금 우리 팀의 DR 수준을…

AI 에이전트 카오스 시대: Claude·OpenClaw가 흔드는 2026 IT 지형

"4년 전 ChatGPT와 나누던 가벼운 대화가 어쩌다 이렇게까지 왔을까요?" 2026년 4월, Anthropic Claude Cowork와 OpenClaw가 동시에 폭발하며 AI 에이전트 카오스 시대가 개막됐습니다. GitHub 247,000 stars, SaaSpocalypse 주가 급락, Anthropic의 OpenClaw 차단과 50배 비용 폭탄까지 — 한국 IT 업계가 알아야 할 5가지 시사점을 3분 만에…

관리형 DB 추천: RDS vs Cloud SQL vs Cosmos DB, 목적별 선택 가이드(2026)

"RDS와 Cloud SQL 중 뭐가 더 좋아요?" — 클라우드 인프라 미팅에서 가장 자주 나오는 질문이지만 정답은 늘 "목적에 따라 다릅니다." 그렇다면 우리 팀에는 무엇이 맞을까요? AWS RDS·Google Cloud SQL·Azure Cosmos DB를 SQL 조인부터 글로벌 분산, HA, 비용 폭탄 포인트까지 7가지 실무 시나리오로 비교해 후회 없는 관리형 DB 추천 기준을 정리했습니다. 도입을 앞두고 있다면 지금 5분만…

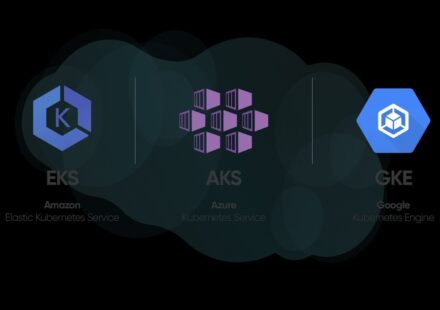

EKS vs AKS vs GKE 비용 비교 2026: 운영 난이도와 숨은 비용까지 정리

EKS, AKS, GKE 비용 비교를 2026년 기준으로 정리했습니다. 관리비, 운영 난이도, 업그레이드 책임, 숨은 비용까지 실무 관점에서 비교합니다.